A Verdade Sobre o Consumo de Água da IA Que Ninguém Te Conta

Manchetes dizem que a IA “bebe” muita água, mas um relatório da A16z traz o contexto real. Veja como ela se compara à agricultura e energia.

Duas vezes por semana, milhões de pessoas ao redor do mundo fazem algo impensável há poucos anos: abrem o ChatGPT e desabafam seus sentimentos mais profundos com uma inteligência artificial.

48,7% dos usuários de IA que reportam problemas de saúde mental estão usando ChatGPT para suporte terapêutico. Não como complemento à terapia tradicional, mas como terapeuta principal.

O mais surpreendente? O principal uso global da IA em 2025 será voltado para terapia e companhia, superando até funções como organização pessoal.

A resposta está na acessibilidade e conveniência. Enquanto uma sessão de terapia custa entre R$ 100 a R$ 300 e exige agendamento, o ChatGPT está disponível 24 horas, 7 dias por semana, gratuitamente.

Usuários relatam que a IA oferece insights sem julgamento, criando um espaço seguro para explorar sentimentos. “Busco uma nova perspectiva, um ponto de vista diferente”, é um comentário comum entre quem adotou essa prática.

A IA também não tem preconceitos ou dias ruins. Ela não cancela consultas, não demonstra cansaço e sempre responde com paciência. Para muitos, isso supera a experiência com profissionais humanos.

O fenômeno vai além de desabafos casuais. 83% das pessoas estão usando o ChatGPT completamente errado, desperdiçando seu imenso potencial para coaching pessoal e profissional.

Usuários experientes criam prompts específicos que transformam a IA em um consultor personalizado. Eles pedem para a IA analisar padrões comportamentais, sugerir soluções para conflitos e até mesmo criar planos de desenvolvimento pessoal.

Alguns comandos populares incluem análise de relacionamentos, planejamento de carreira, gestão de ansiedade e definição de metas. A IA se adapta ao contexto e oferece conselhos personalizados.

Nem tudo são flores nesse relacionamento entre humanos e IA. Especialistas do Conselho Federal de Psicologia alertam para os riscos dessa prática.

A IA não possui formação em psicologia, não consegue identificar transtornos graves e pode dar conselhos inadequados. Em casos de depressão severa ou ideação suicida, a resposta da máquina pode ser insuficiente ou até perigosa.

Existe também o risco de dependência emocional. Pessoas podem desenvolver vínculos artificiais com a IA, evitando relacionamentos humanos reais e aprofundando problemas de isolamento social.

Psicólogos não condenam totalmente o uso da IA, mas enfatizam seus limites. A tecnologia pode ser útil para reflexões iniciais e organização de pensamentos, mas não substitui o acompanhamento profissional.

O maior problema é quando pessoas usam ChatGPT como única fonte de apoio emocional. A IA não compreende nuances emocionais complexas nem oferece intervenções terapêuticas validadas cientificamente.

Especialistas sugerem que a IA seja vista como ferramenta complementar, não substituta. Como um diário interativo que oferece perspectivas diferentes, mas nunca como tratamento principal.

A popularização da terapia por IA reflete uma crise na saúde mental brasileira. Listas de espera longas, custos elevados e estigma social criam barreiras ao tratamento tradicional.

A pandemia também mudou nossa relação com a tecnologia. Pessoas se acostumaram a buscar soluções digitais para problemas antes resolvidos presencialmente.

A qualidade das respostas do ChatGPT evoluiu drasticamente. A IA consegue manter conversas empáticas e oferecer insights genuinamente úteis, criando uma experiência convincente.

Se você decidir experimentar, estabeleça limites claros. Use a IA para reflexões e insights, não para diagnósticos ou crises graves. Em situações sérias, procure sempre ajuda profissional.

Mantenha o pensamento crítico ativo. A IA pode errar ou dar conselhos inadequados para sua situação específica. Use o feedback como ponto de partida, não como verdade absoluta.

Combine IA com relacionamentos humanos reais. A tecnologia deve complementar, nunca substituir conexões genuínas com família, amigos e profissionais qualificados.

A tendência não vai desaparecer. A IA continuará evoluindo e se tornando mais sofisticada no suporte emocional. A questão é como integrar essa tecnologia de forma ética e eficaz.

Provavelmente veremos regulamentações específicas, treinamento de IAs por profissionais da saúde mental e desenvolvimento de ferramentas especializadas para apoio psicológico.

O ChatGPT como terapeuta revela uma necessidade humana profunda por compreensão e apoio. Enquanto não é a solução ideal, oferece um vislumbre de como a tecnologia pode democratizar o cuidado emocional.

Talvez a pergunta não seja se devemos usar IA como terapeuta, mas como podemos fazê-lo de forma que nos torne mais humanos, não menos.

🚀 Resumo Semanal: As três notícias mais impactantes do mundo da IA, selecionadas por especialistas.

✍️ Artigos Práticos: Dicas rápidas de aplicação – desde ferramentas até fluxos de trabalho que você pode usar hoje.

📺 Tutorial ou Ferramenta da Semana: Vídeos e guias que ajudam a turbinar sua produtividade com IA.

🎁 Conteúdo Exclusivo: Acesso antecipado a e-books, webinars e convites para lives.

pessoas já desbloquearam a IA por aqui! Você vai ficar de fora?

Se você chegou até aqui, é porque sabe que não pode mais ignorar o potencial da IA.

Comece agora com nosso tutorial gratuito de ChatGPT em português e saia do zero com clareza, velocidade e autonomia.

Manchetes dizem que a IA “bebe” muita água, mas um relatório da A16z traz o contexto real. Veja como ela se compara à agricultura e energia.

A OpenAI confirmou: um “Modo Adulto” com verificação de idade chegará ao ChatGPT no início de 2026. Tópicos maduros e liberdade estão a caminho.

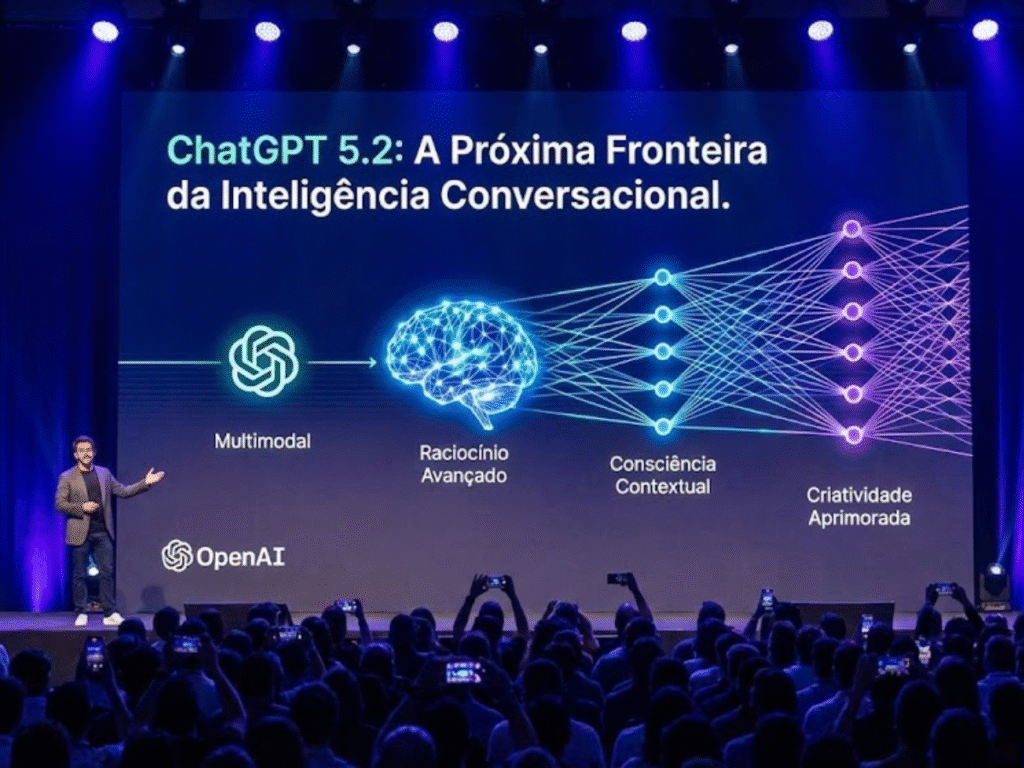

Após um “código vermelho” causado pelo Google Gemini 3, a OpenAI contra-ataca com o GPT-5.2. Mais rápido, inteligente e letal para a concorrência.

A Disney fechou uma parceria de US$1 bilhão com a OpenAI. Mickey, Marvel e Pixar serão integrados ao ChatGPT e Sora. Veja o futuro da mídia.

Uma trend viral perguntou ao ChatGPT o que ele faria se fosse humano por um dia. A resposta poética sobre sentir o sol e o café emocionou a internet.

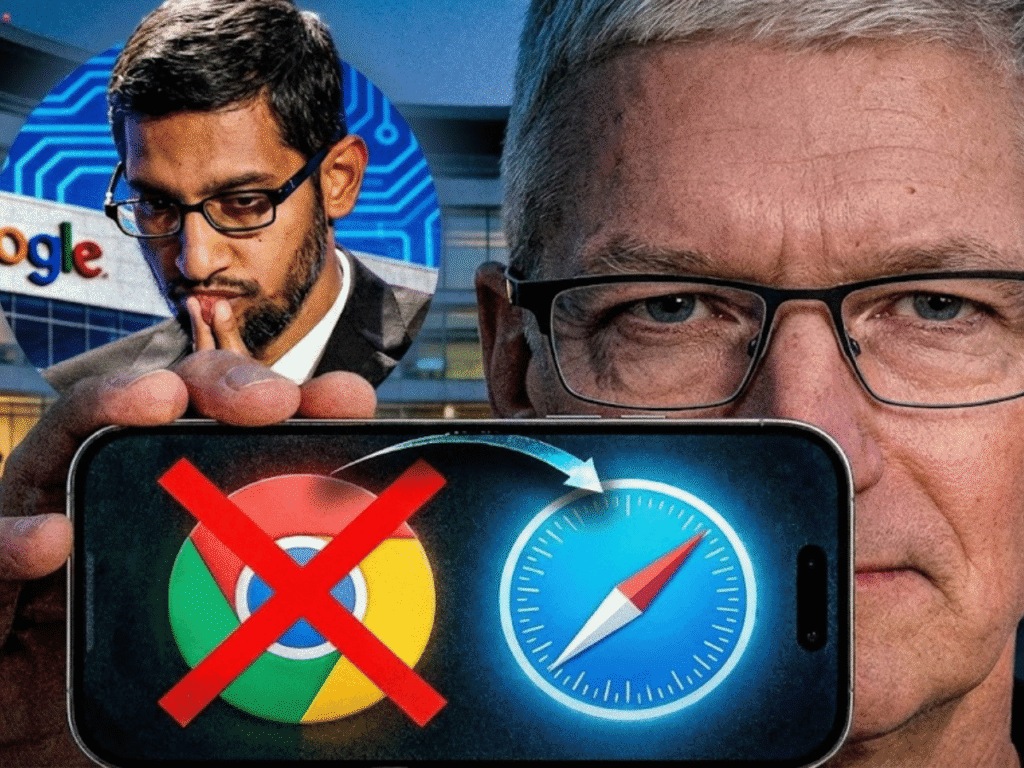

A Apple alertou usuários de iPhone sobre os riscos de privacidade do Google Chrome. O navegador coleta mais dados e expõe usuários a rastreadores.